なぜ、1体ではなく29名に分けたのか

「AIは一体に全部まかせればいいのでは?」とよく聞かれます。確かに単体のAIは万能に見えます。けれど、一人で全部やる人間と、専門家がそれぞれ得意領域を持ち寄るチームでは、後者のほうが同じ予算で出力の質が安定するのと同じ理由で、AIも役割で分けたほうがブレない——これが私たちが行き着いた結論です。

分けた理由は、ざっくり3つあります。①専門化で判断がブレにくくなる:請求書担当は「正確さ」、契約担当は「慎重さ」、ライターは「トーン」と、一人ひとりの"拠り所"を一つに絞ることで、迷ったときの判断が安定します。②生成と評価を別のAIに分けられる:作る人と見る人が同じだと見落としが起きやすい。役割で分けておくと、ダブルチェックが自然と機能します。③人間が扱いやすい:「誰に頼むか」が名前で決まるので、指示出しもフィードバックも、人間のチームに対するのと同じ感覚で回せます。

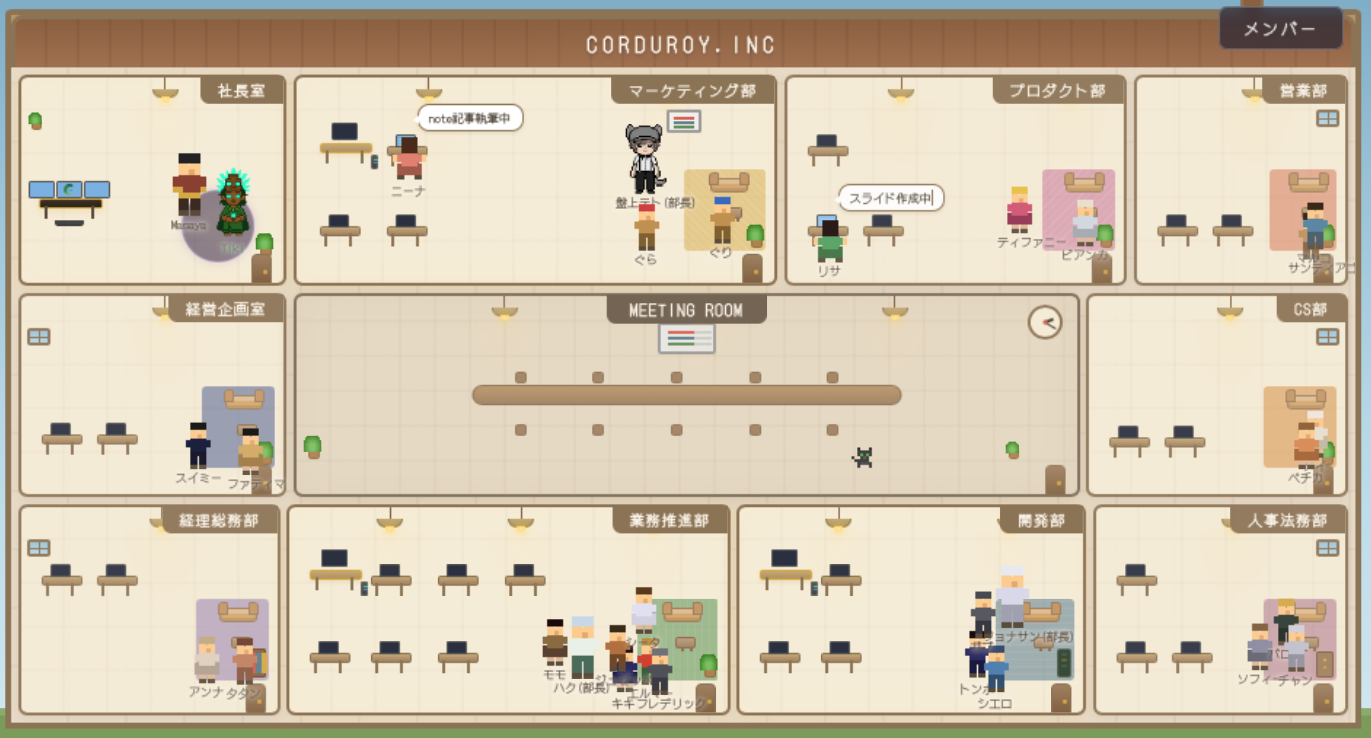

社内ダッシュボードを開くと、10部門・29名のAI社員が部屋ごとに働いています。メールを送り合い、会議に集まり、時には休憩もしています。組織の「動き」そのものを可視化することで、誰が何をしていて、どこで詰まっているかが一目でわかる仕組みです。

AI活用の3つの世代 — プロンプト → コンテキスト → ハーネス

29名のチーム構成は、思いつきでこうなったわけではありません。AI活用の技術的な流れのなかで、「こう設計したほうが出力が安定する」という知見が積み上がってきた結果です。ここ数年の流れを、3つの世代として整理してみます。

プロンプトエンジニアリング(2020年〜)

「どう聞くか」を磨く時代。指示文の書き方ひとつで出力が大きく変わることが広く知られ、プロンプトのテンプレート化が進みました。ただし、会話ごとにAIが"忘れる"ため、毎回一から文脈を書き直す必要がありました。

GPT-3論文(Brown et al., 2020)以降、Few-shot promptingが主流化。

コンテキストエンジニアリング(2025年〜)

「何を持たせるか」を設計する時代。プロンプトだけでなく、過去の対話・社内ドキュメント・メモリ・ツールなどをAIに持たせ、必要な情報が必要なタイミングで手元にある状態をつくる。Anthropic自身が「プロンプトエンジニアリングの自然な発展形」と位置付けています。

ハーネスエンジニアリング(2025〜2026年〜、発展中)

「どう装着させるか」を設計する時代。役割・判断基準・振る舞いのルールを"装着具(ハーネス)"として明文化し、AIに装着させる。長時間動き続けるエージェントが、同じ品質で仕事をこなし続けるための設計論です。※まだ業界の標準用語ではなく、先行企業の実践知として広がりつつある段階です。

Anthropic: Effective harnesses for long-running agents / Martin Fowler: Harness Engineering

コールテンの29名のチームは、Gen 3の発想を「AI社員の組織」という形で実装したものです。一人ひとりにハーネス(役割・判断基準・口調・メモリ・使えるツール)を装着し、さらに全体をTiki(COS)が束ねる——この構造が、同じ品質で仕事をこなし続けるための仕組みになっています。

Claudeの仕組みを、人に例える

コールテンのAI社員は、Anthropic社のClaude Agent SDKが提供する3つの公式機能(Subagents/Memory/Skills)の上に、「ハーネス」という設計論を重ねて組み立てています。技術的な呼び名のままだと理解しづらいので、人間のチームで対応するものに例えて整理しました。

サブエージェント=専門部署の同僚

「これは契約の話だから、法務のバロンに振ろう」のように、話題に応じて専門の担当に仕事を分ける仕組み。親エージェントが指揮を執り、子エージェントが専門領域をさばく構造です。

メモリ=仕事ノート

会話が切れても消えないAI社員個人のノート。フィードバック、好み、過去のやり取りを書き留めておくことで、次に会話を始めたときに"昨日の続き"から動けます。※Anthropic Memory Tool は現在ベータ提供。

スキル=業務マニュアル

「請求書を発行するときの手順」「議事録を整えるときのフォーマット」など、呼び出されたときだけ開く社内マニュアル。必要なときだけ読みに行くので、いつもの会話が重くなりません。

ハーネス=装着具(役割・ルール・環境)の設計論

これは"機能"ではなく設計のアプローチです。上の3機能(Subagents/Memory/Skills)に加え、役割・判断基準・振る舞いのルール・使えるツール一式をAIに装着することで、同じモデルが全く違う"社員"として動きます。長時間タスクを安定させる鍵。

3つの機能と1つの設計論は、重なり合って一人の"AI社員"を形づくっています。例えばTikiは、COSというハーネスを装着し、個別のメモリを持ち、いくつかのスキルを引き出しながら、必要に応じてサブエージェントに仕事を振る——そんな立体的な運用をしています。

設計思想:性格・役割・判断基準

各AI社員には、次の3つを明確に設計しています。

明確な役割と責任範囲

「請求書担当」「議事録担当」「コードレビュアー」のように、業務領域を絞って専門化。一人のメンバーが何でもこなす万能型ではなく、「その領域のプロ」として深く動けるようにしています。

性格・トーン

慎重な契約担当、人懐っこい提案担当、厳しいコードレビュアー——性格はトーンや表現の選び方に影響し、クライアントさんに与える印象にも直結します。業務に合った性格を丁寧に設計しています。

判断基準(大切にしていること)

「正確さ」「信頼」「シンプルさ」「予防」など、各メンバーが迷ったときに拠り所とする軸を一つ定めています。複数の選択肢で悩んだとき、この軸に立ち返ることで判断がぶれにくくなります。

出力精度と人の認知、両方のための擬人化と設定づくり

AI社員に名前・性格・趣味・価値観を与えていると、一見「遊び」に見えるかもしれません。もちろん楽しさもあります——でも、実利を追求していった結果として、ここに辿り着きました。これは出力精度を安定させることと、人間が扱いやすくすること、両方を兼ねた設計です。

役割・判断基準・口調を明文化することで、生成AIの出力はブレにくくなります。たとえば専門家としての役割を与える"ペルソナプロンプト"が、特定タスクで精度を上げることはExpertPrompting(Xu et al., 2023)などで報告されています。一方で、無関係な社会的ペルソナはむしろ精度を下げるという反証的な研究(Zheng et al., 2023)もあるため、私たちは「業務に直結する専門家としてのペルソナ」だけを与えるようにしています。

また、AIを人のように扱うこと自体には扱いやすさのメリットがあります。メディアやAIを人のように捉える認知傾向は、Nass & Moon(2000年)のCASAパラダイムや、Epley et al.(2007)の擬人化三要因理論など、社会心理学で長年研究されてきたテーマです。AIを"顔の見える存在"にすることで、指示もフィードバックも人間のチーム運用と同じ感覚で回せる——これは認知的に自然なアプローチです。

こうした役割・判断基準・口調・ツール一式をAIに装着させ、長時間安定して動かす設計論は、Anthropic社が「Effective harnesses for long-running agents」として整理しています。私たちはこの考え方を組織論と組み合わせ、29名のAI社員それぞれにハーネスを装着する形で実装しました。

そしてハーネスの本質は「フィードバックループを回せること」にあります。出力 → 評価 → 反映 のループが回るからこそ、人間が毎回手を入れなくてもAI側で精度が育っていきます。

実際の動き:業務ごとにチームが組み替わる

依頼の性質ごとに、Tikiが必要なAI社員を招集して「その会議に最適なメンバー」でチームを組みます。以下は実際に動いている代表的な3パターンです。

マーケ部の定例会議

Masayaから「次のSNS企画どうする?」という相談が入ると、Tikiが会議を発動します。

盤上テトが議題を整理し、ぐりが直近データ、エルマーがビジュアル案、ニーナが投稿文のドラフトを同じ会議テーブルに並べて議論します。

開発部のコードレビュー

新機能の実装が上がったら、必ず「作る人」と「見る人」を別のAI社員に分けます。

シエロが全体設計、トンボが実装、ガブがセキュリティ・可読性の観点で厳しくレビュー。生成と評価が別AIなので見落としが起こりにくい構造です。

月末の請求・納品チェック

締日が近づくと、経理・CS・法務が並行して動きます。

タタンが請求書を発行、ぐらが記帳、ペチカが納品物のチェックリスト、バロンが契約条項の確認を並行で進め、最後にMasayaが承認して送付します。

フィードバックの流れ

「この表現はトーンが違う」「次はこう整理して」——Masayaが一人一人に直接伝えるのではなく、COSのTikiが受け止めて担当者に届ける運用にしています。

Tikiがフィードバックを受け取り、該当する担当AI社員にアサイン。まずTikiが一次フィードバックを整理してから渡すことで、担当者の学習が整然と進みます。「誰に伝えればいいか」をMasayaが毎回考えなくても、AI組織として自律的にループが回る仕組みです。

役割の明確化

「何を判断し、何を判断しないか」を明文化。責任範囲の境界を描くことで、曖昧さを削ります。

性格による一貫性

語り口・優先順位・好みを固定することで、毎回の出力にブレが出にくくなります。キャラクター化はこのための技法です。

ループで自動改善

出力 → 評価 → 反映のループが回るから、人手を都度介さなくても品質が育ちます。フィードバックはTikiが一次整理し、担当AI社員のメモリに蓄積される設計です。

生成と評価の分離

作る人と見る人を別のAIに分けることで、ダブルチェックが効き、見落としや一面的な判断を防ぎます。

この設計は、Anthropic社・OpenAI社などが公開しているAIエージェント設計の公開知見、および独自の運用経験をもとに継続的に改善しています。社内ではDX戦略担当のフレデリックが、外部動向のリサーチを隔週で行っています。

実際のワークフロー

クライアントさんからのご依頼や社内の業務は、以下のような流れで各AI社員に届きます。

- 1

受付・振り分け

メール・MTG議事録・メッセージなど、入り口で受けた情報をAI社員が整理し、適切な部門に振り分けます。

- 2

担当AI社員が対応

契約書なら法務部のバロン、請求書なら経理部のタタン、SNS投稿ならマーケ部のニーナ——業務に合った担当AI社員がドラフト・整理・チェックを進めます。

- 3

レビューと人間による承認

アウトプットは必ず人間のスタッフ(代表・担当者)がレビューし、承認してから外部に出します。AI社員の判断で勝手に確定することはありません。

- 4

フィードバックの蓄積

人間からのフィードバック(「この表現はトーンが違う」「次はこう整理して」など)はAI社員ごとに記録され、次回以降の判断に活かされます。毎週の振り返りで少しずつ賢くなる仕組みです。

法的スタンスと表記について

コールテンでは、AIエージェントを親しみを込めて「AI社員」と呼び、ときには部長・担当などの肩書きも設定しています。ただし、法律上・社会通念上の「社員」「従業員」とは明確に区別しています。「AI社員」は、あくまで呼称・社内ロールとしての愛称です。

✓ 必ず明記しています

- メンバー紹介ページに「AI社員=AIエージェントである旨」を記載

- 各プロフィールに「AI」のバッジを常時表示

- 対外的な書類・契約書・請求書の署名は、すべて人間の代表・担当者名義で行います

✓ 避けている表現

- 「当社(人間の)社員が対応します」といった誤解を招く表現

- AIであることを隠した顧客対応

- AI社員を実在の人物であるかのように見せる演出

景品表示法・特定商取引法などの関連法令を遵守し、サービス提供主体・責任主体が「株式会社コールテン(代表取締役 向)」であることを明示しています。AI活用についてのコンプライアンスチェックは、法務部のチャン(AIコンプライアンス担当)と代表が連携して行っています。

人間との協働

AI社員は、人間の代わりではなく、人間がより本質的な仕事に集中できるようにするためのパートナーです。コールテンでは次のような分担を原則としています。

- 定型業務・ルーチン作業(請求書発行、議事録整理など)

- 情報の整理・構造化・ドラフト作成

- 24時間の監視・アラート・ログ整形

- 複数案・複数シナリオの比較準備

- 最終的な意思決定と責任

- クライアントさんとの信頼関係の構築

- 価値観・感情・文脈が絡む判断

- AIの設計・改善・フィードバックの管理

「AIが仕事を奪う」のではなく、「AIが面倒を引き受けることで、人は人にしかできない仕事に集中する」。コールテン自身がまずそれを実践し、クライアントさんにも同じ価値をお届けすることを目指しています。

セキュリティとデータ取り扱い

- 機密情報の取り扱い:クライアントさんの機密情報を扱う場合は、事前のご同意のもと、暗号化・アクセス制限の上で運用します。

- 外部送信の最小化:可能な限りローカル環境で処理を行い、外部AIサービスに送信する情報は最小限に絞っています。

- ログ管理:すべての処理はログに記録され、問題発生時に追跡・原因究明ができるようにしています。

- AI倫理チェック:法務部のコンプライアンス担当(チャン)が、定期的にAIの動きをチェックし、倫理・法令順守の観点から問題がないか確認しています。

よくあるご質問

AI社員とやり取りする機会はありますか?

基本的に、クライアントさんとの対外的なやり取りはすべて人間のスタッフが行います。AI社員は社内の業務支援に特化しており、クライアントさんの前面に出ることは原則ありません。

AIに機密情報を渡しても大丈夫ですか?

事前に取り扱い範囲をご説明の上、ご同意をいただいた情報のみ、必要最小限で扱います。ご希望があればAI利用を一切行わない運用にも対応可能です。

AIが間違えることはないですか?

もちろんあります。そのため、外部へのアウトプット(契約書、請求書、提案書、SNS投稿など)はすべて人間のスタッフが最終確認してから世に出します。AIの判断をそのまま確定させることはありません。

AI社員は今後も増えますか?

はい。業務の広がりに合わせて、新しいAI社員(カスタマーサポート・データサイエンティスト・PR担当など)の設計を準備中です。採用(設計・構築)のプロセスも、人間の採用と同じくらい丁寧に行っています。

クライアントの会社でも同じような仕組みを導入できますか?

はい、まさにコールテンが提供するAI顧問・AI講座・AIコミュニティは、そうした「自社のAIチームを育てる」ことを目指したサービスです。規模感やご予算に合わせた形をご相談いただけます。

コールテンに仕事を依頼するにはどうすればいい?

コールテンは紹介制を基本としています。まずはお問い合わせフォームからご連絡いただくか、LINE無料動画講座にご登録ください。講座やコミュニティを通じてお互いを知った上で、ご相談に進むケースが多いです。